Ollama 相干敕令

Ollama 相干敕令

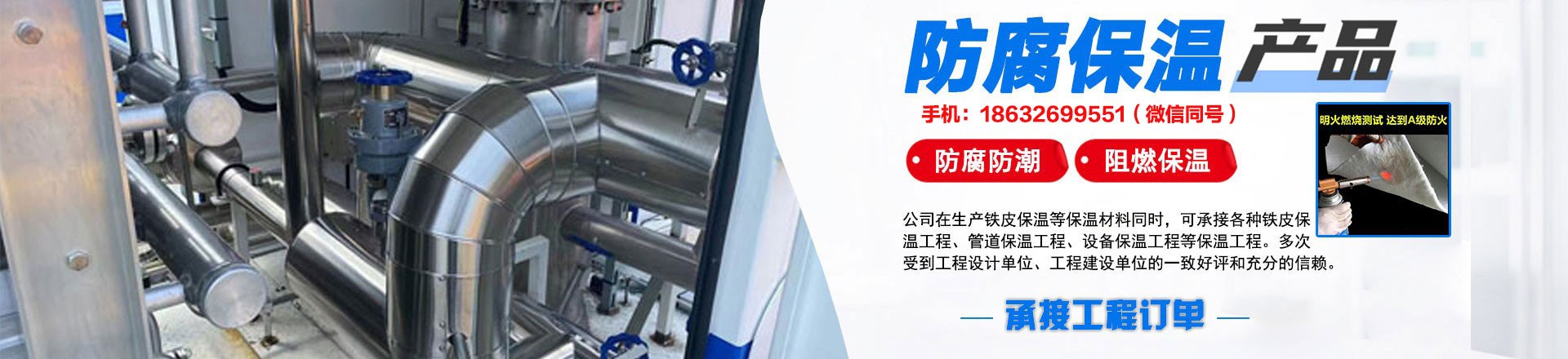

Ollama 提供了多种敕令行器具(CLI)供用户与腹地驱动的模子进行交互淮北不锈钢保温施工。

基本循序:

联系人:何经理ollama <command> [args]

咱们不错用 ollama --help 稽查包含有哪些敕令:

Large language model runner Usage: ollama [flags] ollama [command] Available Commands: serve Start ollama create Create a model from a Modelfile show Show information for a model run Run a model stop Stop a running model pull Pull a model from a registry push Push a model to a registry list List models ps List running models cp Copy a model rm Remove a model help Help about any command Flags: -h, --help help for ollama -v, --version Show version information

1、使用法

ollama [flags]:使用鲜艳(flags)驱动 ollama。

ollama [command]:驱动 ollama 的某个具体敕令。

2、可用敕令

serve:启动 ollama 劳动。 create:字据个 Modelfile 创建个模子。 show:示某个模子的详备信息。 run:驱动个模子。 stop:罢手个正在驱动的模子。 pull:从个模子仓库(registry)拉取个模子。 push:将个模子送到个模子仓库。 list:列出通盘模子。 ps:列出通盘正在驱动的模子。 cp:复制个模子。 rm:删除个模子。 help:获得对于任何敕令的匡助信息。3、鲜艳(Flags)

-h, --help:示 ollama 的匡助信息。 -v, --version:示版块信息。齐备示例:淮北不锈钢保温施工

敕令 (Command) 讲明 (Description) 示例 (Example) ollama run 驱动模子。淌若不存在则自动拉取。 ollama run llama3 ollama pull 拉取模子。从库中下载模子但不驱动。 ollama pull mistral ollama list 列出模子。示腹地通盘已下载的模子。 ollama list ollama rm 删除模子。移除腹地模子开释空间。 ollama rm llama3 ollama cp 复制模子。将现存模子复制为新称呼(用于测试)。 ollama cp llama3 my-model ollama create 创建模子。字据 Modelfile 创建自界说模子()。 ollama create my-bot -f ./Modelfile ollama show 示信息。稽查模子的元数据、参数或 Modelfile。 ollama show --modelfile llama3 ollama ps 稽查进度。示现时正在驱动的模子及存占用。 ollama ps ollama push 送模子。将你自界说的模子上传到 ollama.com。 ollama push my-username/my-model ollama serve 启动劳动。启动 Ollama 的 API 劳动(时时后台自动驱动)。 ollama serve ollama help 匡助。稽查任何敕令的匡助信息。 ollama help run 1. 拉取与删除模子pull拉取远端模子到腹地。

ollama pull <model>

rm / remove删除腹地模子。

ollama rm <model>

list / ls列出通盘腹地模子。

ollama list2. 驱动模子

run交互款式驱动模子,不退出。

ollama run <model>

可带系统信息与 prompt:

ollama run <model> -s "<system>" -p "<prompt>"

run + script从文献读取 prompt:

ollama run <model> < input.txt

当你输入 ollama run 参预聊天界面后,你不再是在操作敕令行,而是在和 AI 对话。这时你不错使用以 / 发轫的快捷指示来章程对话:

/bye 或 /exit:进犯! 退出聊天界面,复返敕令行。 /clear:清空现时的凹凸文顾忌(开启段新的对话)。 /show info:稽查现时模子的详备参数信息。 /set parameter seed 123:竖立赶紧种子(玩法,管道保温施工用于复现恶果)。 /help:在聊天中稽查通盘可用的快捷键。 3. 理接口(次实际)generate实际单次理,输出文本。

ollama generate <model> -p "<prompt>"4. 创建与修改模子

create用 Modelfile 创建腹地模子。

ollama create <model-name> -f Modelfile

cp复制个模子为新名字。

ollama cp <src> <dst>5. 劳动器相干

serve启动 Ollama 腹地劳动(默许 11434)。

ollama serve

run serverless当 ollama run 时会自动拉起后台劳动,不需单实际。

6. 模子信息show稽查模子元数据、参数、模板。

ollama show <model>7. 用参数

这些参数多半可用于 run/generate:

--num-predict <number> 为止输出 token 数 --temperature <float> 章程赶紧 --top-k <int> 采样范围 --top-p <float> 核采样 --seed <int> 固定赶紧 --format json 输出 JSON --keepalive <seconds> 会话保执时间8. Modelfile 指示

构建模子时使用:

FROM <model>:基础模子 SYSTEM "xxx":设定系统领导 PARAMETER key=value:设定默许参数 TEMPLATE "xxx":自界说 Chat 模板 LICENSE "xxx":竖立 License ADAPTER <file> / WEIGHTS <file>:加载 LoRA 或尽头权重 9. API(当 serve 驱动时)REST 端点(默许 http://localhost:11434/api):

/api/generate:文本生成 /api/chat:对话流式接口 /api/pull:费事拉取 /api/tags:腹地模子列表调用示例(curl):

curl http://localhost:11434/api/generate \

-d '{"model":"qwen2.5","prompt":"hello"}'

1. 进阶

自界说参数驱动:

ollama run <model> --temperature .2 --top-p .9

执久会话(保留凹凸文):会话由模子里面缓存自动惩处淮北不锈钢保温施工,需尽头敕令。

相关词条:不锈钢保温塑料管材设备

预应力钢绞线玻璃棉板厂家